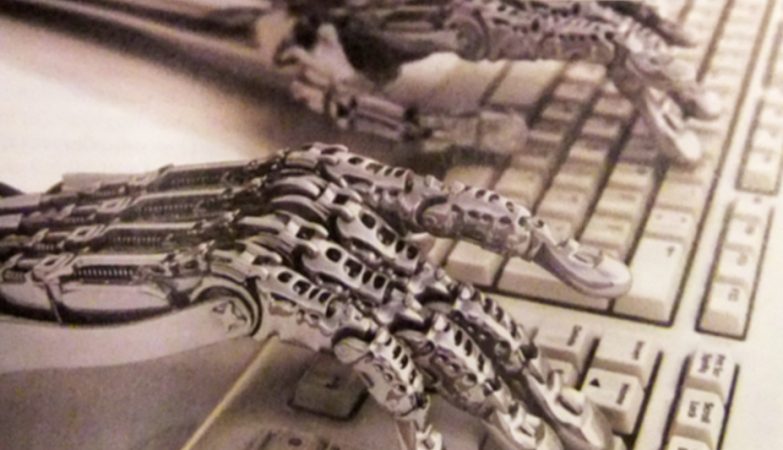

Uma equipa de especialistas defendeu, num relatório intitulado “Uso Malicioso da Inteligência Artificial”, que este sistema está cada vez mais vulnerável a potenciais abusos por Estados não reconhecidos internacionalmente.

No relatório “Uso Malicioso da Inteligência Artificial”, a equipa de especialistas adverte para o facto de a Inteligência Artificial estar cada vez mais vulnerável a potenciais abusos por Estados não reconhecidos internacionalmente.

Segundo o relatório, publicado na semana passada, criminosos e terroristas serão capazes, num futuro próximo, de transformar drones em mísseis, de disseminar ainda mais vídeos falsos para manipular a opinião pública e de criar mecanismos automáticos para executarem ciberataques.

De acordo com o Expresso, estas são três das ameaças destacadas no documento de 100 páginas, que identifica as três áreas de maior vulnerabilidade: o digital, a segurança física e a política.

O “Uso Malicioso da Inteligência Artificial” lança ainda um pedido àqueles que desenvolvem estes sistemas de AI, para que façam mais para mitigar potenciais maus usos e abusos das suas tecnologias. Sugerem também que os Governos aprovem uma nova legislação na área para impedir estas ameaças.

O grupo de especialistas defende, segundo o jornal, que tanto legisladores como investigadores devem trabalhar em conjunto para se prepararem para o uso malicioso da IA num futuro próximo, de forma a que todos se consciencializem sobre a importância destes perigos – apesar dos pontos positivos desta tecnologia.

À BBC, Shahar Avin, do Centro de Estudos sobre Riscos Existenciais da Universidade de Cambridge, disse que o relatório se centra em áreas já democratizadas, descartado os perigos da Inteligência Artificial num futuro mais distante.

Para o especialista, o principal perigo reside na área de reforço da aprendizagem, em que a Inteligência Artificial é treinada a níveis que ultrapassam as nossas capacidades, sem orientação ou exemplos humanos.

Em breve, pessoas mal-intencionadas poderão ser capazes de treinar um drone com software de reconhecimento facial para encontrarem determinados alvos facilmente e, num futuro próximo, hackers usar tecnologias como a AlphaGo, uma AI desenvolvida para explorar padrões em quantidades maciças de dados e falhas nos códigos informáticos.

“A Inteligência Artificial vai alterar os cenários de risco para os cidadãos, organizações e Estados”, defende Miles Brundage, investigador do Instituto para o Futuro da Humanidade na Universidade de Oxford.

O especialista vai mais londe e refere que, “muitas vezes, os sistemas de AI não se limitam a alcançar níveis humanos de performance, vão muito mais longe que isso. É preocupante mas necessário que se considerem as implicações de ciberataques”, alerta.

Para Seán Ó hÉigeartaigh, diretor executivo do Centro para o Estudo de Riscos Existenciais e um dos autores do relatório, “a Inteligência Artificial veio mudar as regras do jogo”.

“Vivemos num mundo que pode tornar-se pleno de perigos diários por causa dos abusos da AI e precisamos de assumir a responsabilidade por estes problemas, porque os riscos são reais. Já chega“, conclui hÉigeartaigh.

Como toda a tecnologia, pode ser usada para o bem ou para o mal. Tudo depende de quem faz uso dela e a sua intenção.