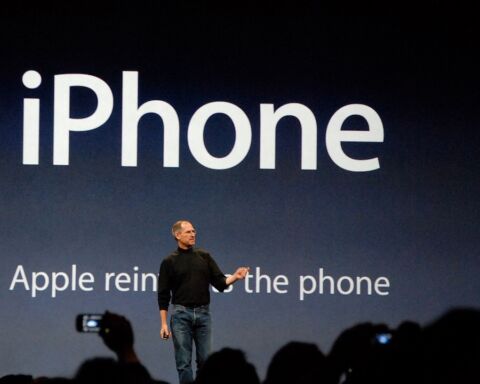

Young & Rubicam Mexico / Save the Children

Campanha contra a pedofilia da ONG Save the Children

O mecanismo de recomendações automáticas do YouTube tem vindo a sugerir vídeos infantis a utilizadores que tinham acabado de assistir a outros conteúdos com cariz sexual.

No Brasil, uma mulher identificada como Christiane ficou preocupada ao ver o elevado número de visualizações num vídeo que a filha publicou no YouTube. O mesmo continha imagens da menina a brincar com os amigos na piscina de casa. De acordo com um artigo do BoingBoing, o canal “sexualizou a sua filha e empurrou a sua imagem para pedófilos”.

Segundo escreveram Max Fisher e Amanda Taub no New York Times, o sistema de recomendação automatizado do YouTube – que sugere o que os utilizadores devem ver – começou a exibir o vídeo da menina para utilizadores que assistiram a outros vídeos de crianças e adolescentes parcialmente vestidos.

“É o algoritmo do YouTube que coneta esses canais”, disse Jonas Kaiser, um dos três investigadores do Centro Berkman Klein Center, de Harvard, que tropeçou nos vídeos enquanto analisava o impacto da plataforma no Brasil. “Isso é assustador”, afirmou.

O vídeo da filha de Christiane foi promovido pelos sistemas do YouTube meses depois de a empresa ter sido alertada sobre problemas de pedofilia. Em fevereiro deste ano, a Wired e outras agências de notícias informaram que os predadores estavam a usar a seção de comentários de vídeos daquele canal para orientar outros pedófilos quanto aos vídeos.

Naquele mês, definindo o problema como “profundamente preocupante”, o YouTube desativou os comentários em muitos vídeos com crianças. Mas o sistema de recomendação, que permanece em vigor, reuniu dezenas de vídeos desse tipo num novo e facilmente visível repositório, que são recomendados para um vasto público.

“O algoritmo do YouTube tem feito curadoria de filmes caseiros de famílias, colocando-os num catálogo de crianças semi-nuas”, escreveu o jornalista Max Fisher, na página de Twitter do New York Times.

“O YouTube geralmente reproduz os vídeos depois que os utilizadores assistem a pornografia ‘softcore’, criando uma audiência de milhões, naquilo que os especialistas chamam de exploração sexual infantil”, referiu noutra publicação.

“Perguntei ao YouTube – por que não desativar as recomendações de vídeos de crianças? O vosso sistema já pode identificar vídeos de crianças automaticamente”, escreveu ainda o Max Fisher. “O algoritmo de recomendação está a conduzir todo esse fenómeno de exploração infantil. Desligá-lo resolveria o problema e manteria as crianças seguras”.

Num comunicado divulgado no seu site oficial na segunda-feira, o YouTube respondeu que, nos últimos dois anos, tem feito melhorias regulares no seu sistema de recomendação automática, que “ajudam a proteger os menores e as famílias”.

“Lançamos a nossa melhoria mais recente no início deste mês. Com essa atualização, poderemos identificar melhor os vídeos que podem colocar em risco os menores e aplicar as nossas proteções, incluindo as descritas acima, a mais vídeos”, acrescentou.