Autoconsumo dos modelos IA pareceu “estragar” o seu cérebro digital, que ficou literalmente MAD. A Internet como a conhecemos corre o risco de ser comprometida.

Quem diria que o maior inimigo da Inteligência Artificial pode mesmo ser…a Inteligência Artificial.

Após alimentarem modelos IA com conteúdos gerados por outro IA, cientistas da Universidade de Rice e Stanford verificaram que a qualidade do modelo ficou corrompida, segundo revelações impressionantes de um estudo publicado na arxiv.

“Avanços sísmicos em algoritmos de IA geradores de imagens, texto e outro tipo de dados levaram à tentação de usar dados sintéticos para treinar os modelos da próxima geração. Repetir esse processo cria um loop de ‘autoconsumo’ cujas propriedades não se percebem muito bem”, afirmam os investigadores, segundo o Futurism.

O autoconsumo dos modelos IA parece “estragar” o seu cérebro digital com grandes modelos de linguagem e geradores de imagem. Na verdade, os modelos ficam literalmente MAD (inglês para “loucos”).

“Sem dados reais atualizados o suficiente em cada geração de um loop, os futuros modelos generativos estão condenados a uma constante diminuição da sua qualidade (precisão) ou diversidade (recolha). “Chamamos a esta condição Transtorno de Autofagia dos Modelos (Model Autofagy Disorder, ou MAD).

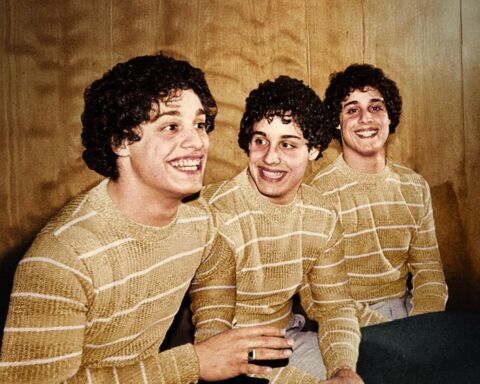

Um tweet recente ilustra o perfeito exemplo deste fenómeno. Quando se treina um modelo IA com os seus próprios outputs, as imagens não sobrevivem a mais que 5 iterações sem começarem a perder o sentido de realidade.

Cool paper from my friends at Rice. They look at what happens when you train generative models on their own outputs…over and over again. Image models survive 5 iterations before weird stuff happens.https://t.co/JWPyRwhW8o

Credit: @SinaAlmd, @imtiazprio, @richbaraniuk pic.twitter.com/KPliZCABd4

— Tom Goldstein (@tomgoldsteincs) July 7, 2023

Se for treinado constantemente por conteúdo sintético, o modelo começa a perder informação menos representativa e cada vez mais converge para informação menos variada, acabando, por falta de intervenção humana, por ser assassinado às mãos da sua própria espécie.

IA mata IA. Quais são as implicações no mundo real?

Apesar de não se poder dizer que a Internet já é dominada por conteúdo gerado por IA, o aumento constante do mesmo nas plataformas web é inegável.

Como tal, a recolha da informação disponível por parte dos novos modelos generativos, que os alimenta, vai ficando cada vez mais precária — e, pelos vistos, vai levar estes modelos à loucura.

“Como os conjuntos de dados de treino para modelos de IA generativa tendem a ser provenientes da Internet, os modelos de IA de hoje estão involuntariamente a ser treinados em quantidades crescentes de dados sintetizados por IA”, avisam os investigadores.

Se esta tendência se verificar, as empresas vão ter cada vez mais dificuldades em assegurar uma boa base de dados nos seus modelos… e não só.

Se tal degradação acontecer e o conteúdo IA passar a reinar na web, a qualidade e estrutura da Internet como a conhecemos corre o risco de ser comprometida.

“Aquilo que antes eram fontes de texto humanas são cada vez mais criadas por modelos IA generativos, desde críticas de utilizadores a notícias de websites, muitas vezes sem indicação de que o texto é sintético. Com o uso de IA a crescer rapidamente, esta situação só vai acelerar”, lembram.