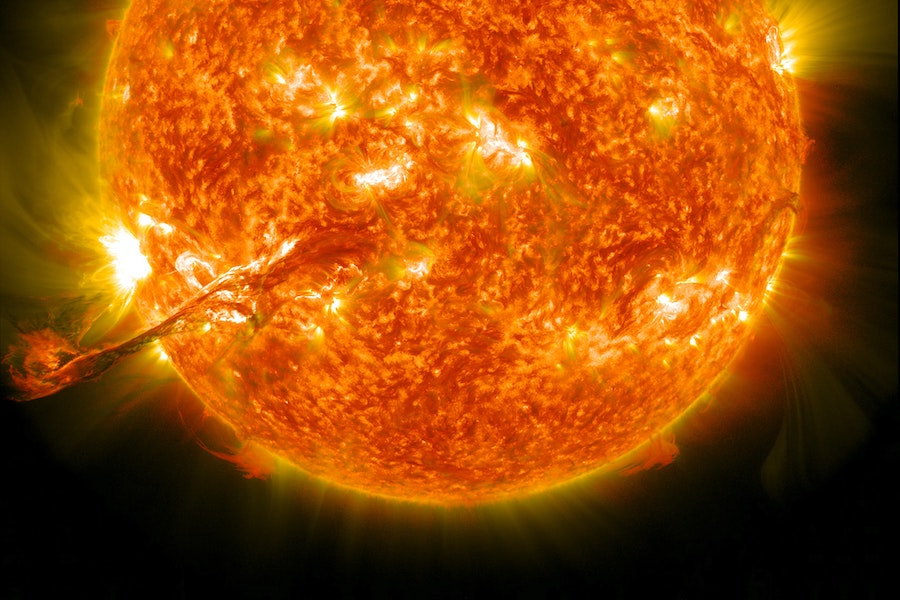

ZAP // geralt / pixabay

O CEO do Google, Sundar Pichai, revelou recentemente numa entrevista que os sistemas de inteligência artificial (IA) da empresa começaram a desenvolver habilidades por conta própria, sem programação explícita.

Pichai e o vice-presidente de tecnologia e sociedade da Google, James Manyika, disseram à CBS News que a sua IA mostrou “propriedades emergentes”, o que é considerado um problema misterioso na investigação de IA.

Pichai disse que alguns sistemas de IA estão a ensinar a si mesmos habilidades que não eram esperadas deles, e as razões para isso não são bem compreendidas. Um programa de IA da Google, por exemplo, adaptou-se ao idioma de Bangladesh após ser solicitado em bengali, um idioma no qual não foi treinado.

Manyika explicou que com apenas algumas instruções em bengali, a IA poderia traduzir “todo o bengali”. No entanto, embora isso possa parecer impressionante, outros investigadores de IA não se impressionam.

One AI program spoke in a foreign language it was never trained to know. This mysterious behavior, called emergent properties, has been happening – where AI unexpectedly teaches itself a new skill. https://t.co/v9enOVgpXT pic.twitter.com/BwqYchQBuk

— 60 Minutes (@60Minutes) April 16, 2023

A cientista de pesquisa em computação e IA Margaret Mitchell sugeriu que os dados de treino usados para a IA podem ter contido bengali.

Mitchell explicou que o modelo PaLM, que é o precursor do Bard, já tinha sido treinado em bengali. Portanto, não é exagero supor que o Bard, que incorporou o trabalho do PaLM, também incluiu o bengali nos seus dados de treino. Ao solicitar um modelo treinado em bengali com bengali, ele deslizará facilmente para o que sabe de bengali.

Em resposta ao artigo do BuzzFeed News, um porta-voz da Google confirmou que a IA realmente foi treinada em bengali, mas não foi treinada para traduzir idiomas ou responder a perguntas no formato de perguntas e respostas. Ela aprendeu essas habilidades por conta própria, o que ainda é considerado uma conquista impressionante.

Embora o desenvolvimento de habilidades pela IA sem programação explícita seja considerado impressionante, levanta preocupações sobre a capacidade dos investigadores de entender o funcionamento da IA.

Pichai admitiu que existe um aspeto da IA a que chamam de “caixa negra”, que não é totalmente compreendido, e os cientistas não conseguem dizer porque é que tomou certas decisões ou porque é que errou em coisas.

E por aqui se vê claramente que a humanidade vai alegremente a caminhar para a sua auto extinção.

Welcome to the judgment day……Terminator 2

Mas despediram na altura o seu Eng. Blake Lemoine por este dizer que a IA tinha ganho vida própria… afinal foi um despedimento sem justa causa!