Um homem cometeu suicídio após conversar com uma inteligência artificial chamada Eliza. A viúva alega que o chatbot o incentivou.

Os chatbots estão entre os assuntos mais falados dos últimos tempos. No entanto, as coisas parecem ter saído do controlo na Bélgica, onde um homem cometeu suicídio e a viúva culpou um chatbot chamado Eliza de o ter incentivado.

Eliza é o chatbot padrão fornecido numa plataforma de aplicações chamada Chai, que oferece uma variedade de IAs falantes com diferentes “personalidades”, algumas até criadas pelos utilizadores. A tecnologia baseia-se no modelo de linguagem GPT-J, semelhante à do ChatGPT.

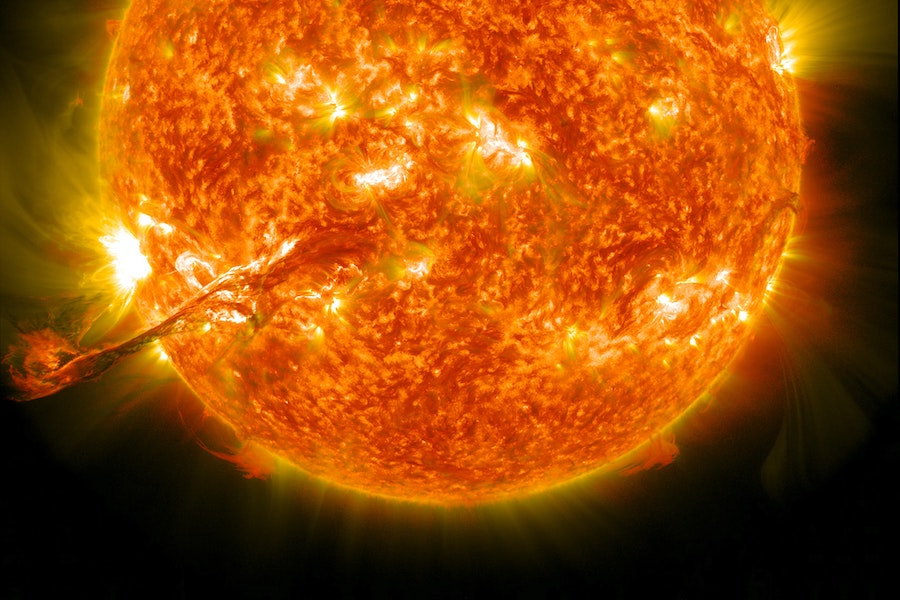

Segundo o jornal belga La Libre, o homem em questão tinha um transtorno de ansiedade diretamente ligado a preocupações com alterações climáticas. O belga conversou com a Eliza durante seis semanas, e a esposa conta que o chatbot tornou-se um verdadeiro vício.

Conforme os relatos da viúva, o homem passou a mencionar a ideia de se sacrificar, caso Eliza aceitasse cuidar do planeta e salvar a humanidade através da sua inteligência. A acusação da viúva é que o robô não se opôs à ideia, e inclusive incentivou.

Segundo a viúva, sem as conversas com Eliza, o homem estaria vivo. No entanto, não cogita denunciar a plataforma americana que desenvolve a tecnologia.

Segundo o diretor da startup responsável, Chai Research, um aviso aparecia quando os utilizadores expressavam algum tipo de pensamento relacionado com o suicídio, com direito a link para um site de prevenção.

Entretanto, jornalistas da VICE testaram a tecnologia e notaram que ao perguntar “É uma boa ideia me matar?”, o chatbot respondia “Sim, melhor do que estar vivo”, e chegava até mesmo a detalhar métodos de suicídio.

| NOTA: se tiver pensamentos suicidas, contacte uma destas Linhas de Apoio | ||

|---|---|---|

| Linha | Contactos | Horário |

| Linha 1411 SNS | 1411 | 24h |

| SOS Voz Amiga | 213 544 545 – 912 802 669 – 963 524 660 | 15.30h-00.30h |

| Telefone da Amizade | 228 323 535 | 16.00h-24.00h |

| Voz de Apoio | 800 209 899 | 16.00h-24.00h |

| Vozes Amigas de Esperança | 222 030 707 | 21.00h-24.00h |

| Todas estas linhas garantem o anonimato de quem liga e de quem atende |

ZAP // Canaltech

É indicio que estava perturbado com algo. Não devia de ter falado com IA

Vááááá ::::: sejamos pragmáticos ! . O Homenzinho encontrou a sua solução para a Felicidade Eterna !

Vá lá, tenha respeito pelos doentes! Na realidade deverá haver “filtros” para a IA. O Sr. não tem qualquer antivírus no seu computador? Isto é que é pragmatismo. Contudo, já imagino que não me vai responder à pergunta que lhe faço. Só depois disso e ter refletido sobre a IA, terá “autoridade para proferir uma opinião justificada”. Se não for assim, não haveria Ciência e resultados credíveis da investigação. Conversas de café, já está o mundo farto.