A capacidade de criar imagens artificiais, especialmente as deepfakes, está cada vez mais acessível, tornando a deteção dessas falsificações uma necessidade crescente.

Investigadores da Universidade de Hull descobriram uma técnica inovadora para identificar deepfakes, inspirada em métodos utilizados na astronomia.

Apresentada na Reunião Nacional de Astronomia da Sociedade Real de Astronomia, a pesquisa liderada por Adejumoke Owolabi, estudante de mestrado na Universidade de Hull (do Reino Unido), revela que a análise das “estrelas” nos olhos humanos pode ser uma ferramenta eficaz na deteção de imagens falsas geradas por IA.

Atenção aos olhos em deepfakes

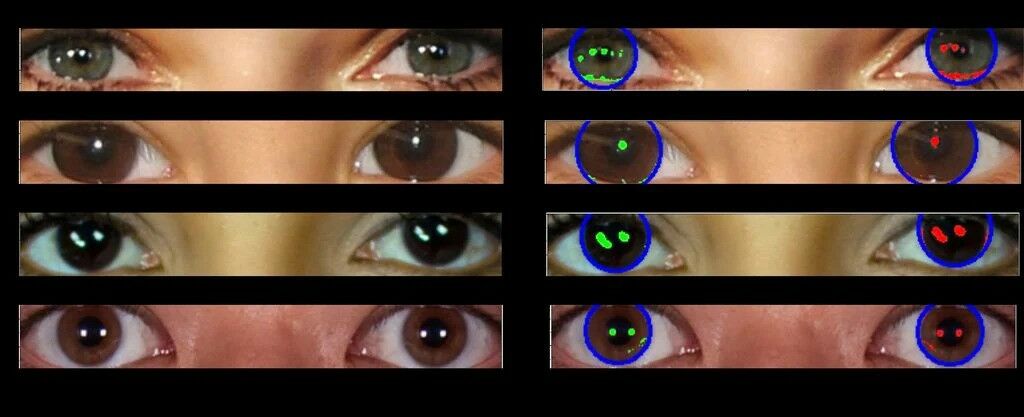

A técnica baseia-se na observação das reflexões de luz nos olhos. Em imagens reais, as reflexões nos olhos são consistentes entre si, enquanto em deepfakes, essas reflexões tendem a ser discrepantes.

O professor de astrofísica na Universidade de Hull, Kevin Pimbblet, explica que “os reflexos nos globos oculares são consistentes para a pessoa real, mas incorretos (do ponto de vista físico) para a pessoa falsa”.

Adejumoke Owolabi / Royal Astronomical Society

Os reflexos nos olhos são consistentes em fotos reais

Na apresentação durante a conferência de astronomia, os investigadores mostraram como aplicaram métodos astronómicos tradicionais, usados para estudar a morfologia de galáxias, na análise das imagens.

Eles quantificaram as reflexões nos olhos e compararam a consistência entre os olhos esquerdo e direito utilizando índices como o CAS (Concentração, Assimetria e Suavidade) e o coeficiente de Gini, que mede a distribuição da luz.

O coeficiente de Gini, originalmente utilizado para analisar a distribuição de luz em galáxias, revelou que os deepfakes apresentam inconsistências notáveis nas reflexões oculares em comparação com imagens reais.

Embora o método não seja infalível e possa gerar falsos positivos e negativos, ele representa um avanço significativo na deteção de deepfakes.

“Ainda não é uma solução definitiva, mas oferece uma base sólida para enfrentar o desafio dos deepfakes”, afirmou o professor Pimbblet, que destaca que, apesar das limitações, a técnica fornece uma estratégia promissora na luta contra a desinformação e a manipulação visual promovida por deepfakes.

// CanalTech