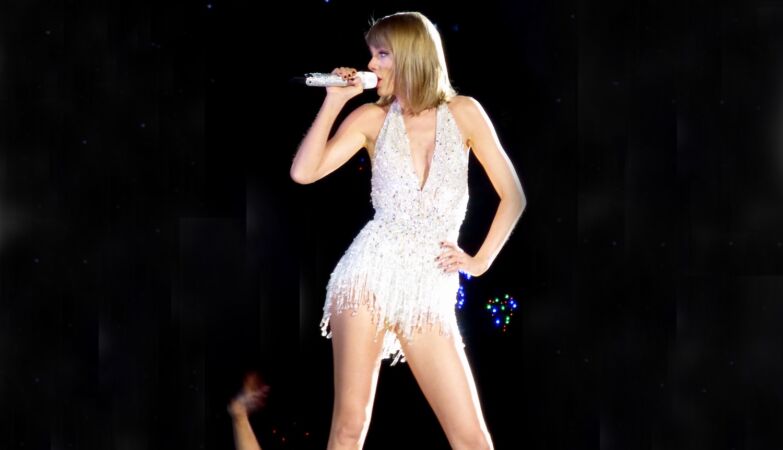

Imagens pornográficas falsas de Taylor Swift, criadas através de Inteligência Artificial generativa, estão a ser amplamente partilhadas nos últimos dias em redes sociais e a gerar indignação entre a classe política norte-americana e fãs da cantora.

Uma dessas imagens já foi vista mais de 47 milhões de vezes na rede social X, onde de acordo com os ‘media’ norte-americanos, permaneceu durante mais de 17 horas antes de ser excluída, noticiou esta sexta-feira a agência France-Presse.

As imagens pornográficas falsas, ou deepfakes, de mulheres famosas, mas também dirigidas a muitas pessoas anónimas, não são novidade.

Mas o desenvolvimento de programas generativos de IA corre o risco de produzir um fluxo incontrolável de conteúdos degradantes, segundo muitos ativistas e reguladores.

Desenvolver estas imagens requer uma rede neural profunda, isto é, um sistema informático que imita a forma como o cérebro aprende. Tal capacidade é “treinada”, por exemplo, através de uma exposição a conjuntos de dados cada vez mais vastos de imagens reais.

Entretanto, a evolução exponencial das capacidades da IA generativa tem levado a que as imagens falsas produzidas sejam cada vez mais realistas — ao ponto de pessoas que nem existem parecerem mais reais do que verdadeiros humanos.

O facto de tais imagens afetarem desta vez Taylor Swift, a segunda artista mais ouvida do mundo na plataforma Spotify, poderá, no entanto, ajudar a sensibilizar as autoridades para o problema, perante a indignação dos seus milhões de fãs.

“O único ponto positivo de que isto esteja desta vez acontecer com Taylor Swift é que ela pesa o suficiente para que seja aprovada uma lei para eliminar isto”, sublinhou no X Danisha Carter, influenciadora com várias centenas de milhares de seguidores nas redes sociais.

O X é conhecido por ter regras menos rígidas sobre nudez do que o Instagram ou o Facebook. A Apple e a Google têm o direito de controlar o conteúdo que circula nas aplicações através das regras que impõem aos seus sistemas operativos móveis, mas toleraram esta situação no X, até agora.

Num comunicado de imprensa, o X garantiu que tem “uma política de tolerância zero” relativamente à publicação não consensual de imagens de nudez. A plataforma declarou que estava “a remover todas as imagens identificadas” da cantora e “a tomar as medidas necessárias contra as contas que as publicaram”.

Representantes da cantora norte-americana ainda não comentaram esta situação.

“O que aconteceu a Taylor Swift não é novo, as mulheres têm sido alvo de imagens falsas sem o seu consentimento durante anos”, lembrou a congressista democrata Yvette Clarke, que apoiou uma lei para combater o fenómeno. “Com os avanços na IA, criar estas imagens é mais fácil e barato”, lembrou.

Um estudo realizado em 2019 estimou que 96% dos vídeos ‘deepfakes’ eram de natureza pornográfica. De acordo com a revista Wired, 113 mil desses vídeos foram carregados nos principais ‘sites’ pornográficos durante os primeiros nove meses de 2023.

Apesar dos esforços das plataformas de conteúdo para controlar a disseminação deste tipo de imagens, a verdade é que o fenómeno parece estar fora de controlo.

E, realça a Wired, se Taylor Swift não consegue vencer o deepfake porn, então ninguém consegue.

ZAP // Lusa